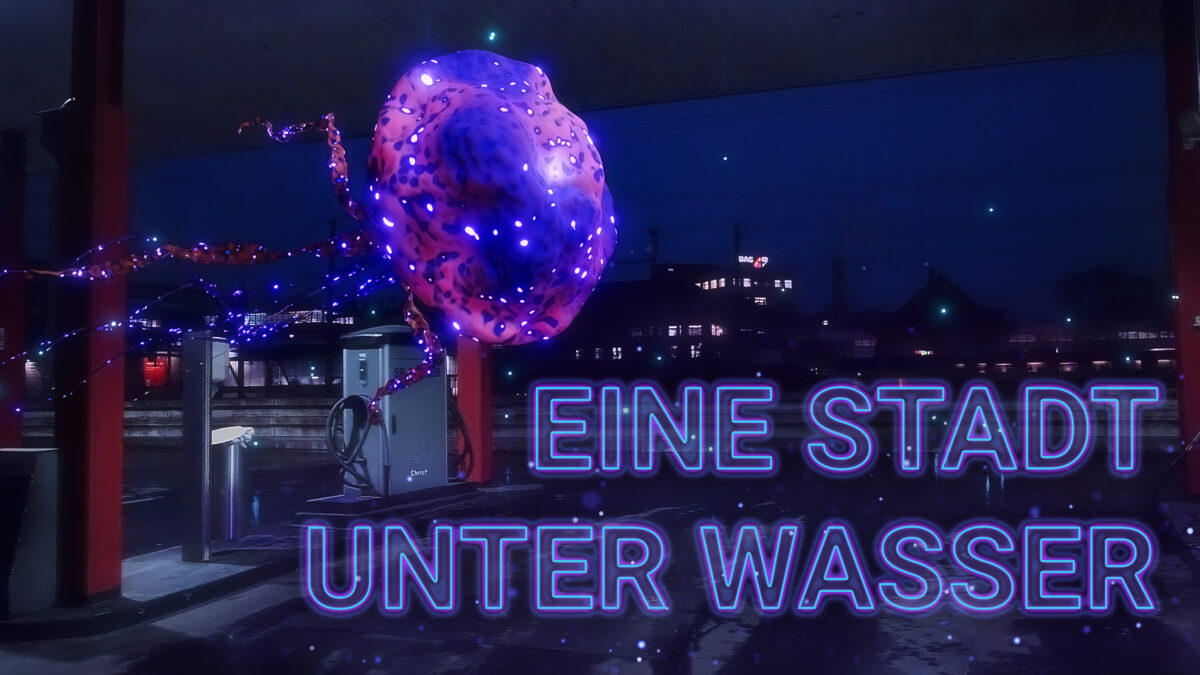

Eine Stadt unter Wasser

Jedes Jahr steigt der Meeresspiegel aufgrund der globalen Erwärmung durchschnittlich um 3,2 Millimeter an. Wenn alles Eis auf der Erde vom einen auf den anderen Tag schmelzen würde, wäre der Meeresspiegel 60 Meter höher als jetzt. Unsere Welt wäre eine andere.

Wie wohl so eine Welt aussehen würde, in der die Ozeane ganze Städte fluten und Meerestiere sich einen neuen Lebensraum nehmen? Mit dieser Frage habe ich mich an mein Projekt gesetzt und nach Antworten gesucht. Entstanden ist ein alternatives Universum, in dem mystische Kreaturen und leuchtende Korallen meine Stadt erobern. Dies wird wohl nie in dieser Form geschehen, aber guten Stoff für einen dystopischen Science-Fiction-Film liefern die drei Videos auf jeden Fall.

(ash)

Die Idee

Als ich dieses Projekt begonnen habe, war es in Bern dauern bewölkt, dunkel und nass. So kam mir die Idee, eine Unterwasserwelt zu gestalten. Eine Welt, in der das Meer Bern geflutet hat. Ich wollte eine Serie aus kurzen Handyvideos erstellen, die diese neue Welt und ihre Tiere dokumentiert und authentisch wirkt. So als hätte sie jemand zufällig mit dem Handy aufgenommen. Es sollte ein Mix zwischen echten Aufnahmen und Animation werden. Da ich mich aus ästhetischen Gründen und zugunsten des Storytellings dafür entschieden habe, in der Blue Hour zu filmen, musste ich meine ISO-Starke Kamera verwenden statt ein gewöhnliches Smartphone. Die Tiere die vorkommen sind eine Qualle, ein Mantarochen, eine Schildkröte und kleine Fische. Ich finde all diese Tiere haben etwas aussergewöhnliches an sich, was den Videos eine gewisse Mystik und Spannung verleiht. Durch den abstrakten Look mit leuchtenden Violett, Blau und Orange-Tönen lässt das Video viel Spielraum für Fantasie und Interpretation. Ich möchte dem Zuschauer nicht ein klares Narrativ vermitteln, sondern dessen Fantasie anregen.

Das Ziel & die technische Umsetzung

Das Hauptziel dieses Projektes war für mich, die Technik des Motion-Tracking kennen zu lernen. Bei dieser Technik sucht man kontrastreiche Bereiche in einem Video und lässt deren Bewegung im Bild vom Computer tracken. Wenn man genug solche Punkte findet und der Computer diese korrekt trackt, kann man am Ende die Kamerabewegung herausrechnen und entsprechend eine 3D Kamera in Blender erstellen, die die Bewegung der realen Kamera nachahmt. Dadurch können 3D Objekte realistisch in echten Aufnahmen platziert werden.

Als ersten Versuch habe ich einige Aufnahmen draussen aufgenommen, anhand von mehreren Tutorials das Motion-Tracking in Blender gelernt und einen weissen Würfel in eine Aufnahme eingesetzt. Das Ergebnis war überraschend gut und hat mich sehr motiviert. Nun wusste ich auch besser bescheid, was ich beim Aufnehmen beachten muss, damit ich später das Video möglichst einfach tracken kann. Mit den gewonnen Erkenntnissen habe ich an verschiedenen Tagen viele weitere Aufnahmen an verschiedenen Locations gemacht und mich dann Schritt für Schritt für die drei Videos entschieden, die ich schlussendlich verwendet habe. Die 3D-Animationen habe ich in Blender erstellt, wobei ich für den Mantarochen und die Schildkröte gratis 3D-Modelle im Internet gefunden habe, die ich dann selber verändert und animiert habe. Für eine realistischere Beleuchtung habe ich mit einer 360 Grad Kamera von jeder Location ein Bild gemacht, dass ich in Blender als HDR-Environment verwenden konnte. Ein schwieriger aber sehr spannender Teil der Arbeit war es, die Schatten und Reflexionen auf dem Boden zu simulieren. Dazu habe ich kein Tutorial gefunden und nach langem herumtüfteln eine Lösung gefunden, die sehr gut funktioniert hat. Die verschiedenen Render-Layers wie das Hintergrundvideo, die Reflexionen, das Leuchten und die Animation habe ich in After Effects kombiniert. Das finale Video habe ich mit Adobe Audition sehr aufwändig vertont bis ich gemerkt habe, dass die Videos besser wirken wenn die originale Tonspur im Mittelpunkt steht.

Fazit & Learnings

Die grössten Learnings hatte ich aufjedenfall beim Motion-Tracking. Ich habe den ganzen Ablauf viermal durchgespielt und fühle mich jetzt ziemlich sattelfest in dieser Technik. Ich habe mir ein kleines Cheatsheet mit den wichtigsten Dingen erstellt, die beim Motion-Tracking beachtet werden müssen (z.B. Shutterspeed 160/s oder höher da es sonst zu Bewegungsunschärfe kommt, bei homogenen Flächen ein paar Steinchen als Tracking-Punkte platzieren, das Tracking wirklich sauber abschliessen bevor man im Prozess weiter geht da späteres Korrigieren der Kamera sehr mühsam ist und wie man die Kamerabewegung glätten kann, falls das Tracking nicht ganz sauber funktioniert hat). Zudem habe ich Adobe Audition besser kennengelernt und Erfahrungen beim Animieren von Tieren sammeln können. Alles in allem war dies ein lehrreiches und spannendes Projekt das mir viel Freude bereitet hat und mir neue Möglichkeiten eröffnet.